בעלי עסקים רבים משקיעים זמן וכסף בתוכן, עמודי נחיתה וקמפיינים ממומנים, אבל מתעלמים מהשכבה שמתחת לכל זה: התשתית הטכנית של האתר. גוגל לא יכול לדרג מה שהוא לא מצליח לסרוק, להבין או לאנדקס. SEO טכני הוא הטיפול במנוע שמניע את כל מערך השיווק הדיגיטלי שלכם, ובמאמר הזה נפרק אותו לרכיבים מעשיים שאפשר ליישם.

- מה זה Technical SEO ומה בדיוק נכנס לתמונה?

- למה SEO טכני חשוב גם כשהתוכן מעולה?

- ההבדל בין SEO טכני, On-Page ו-Off-Page

- איך גוגל סורק, מרנדר ומאנדקס אתר בפועל?

- אודיט Technical SEO – מאיפה מתחילים?

- איך יודעים אילו דפים גוגל באמת מאנדקס?

- Crawl Budget – מתי באמת משנה?

- הטעות הכי מסוכנת ב-Robots.txt

- Sitemap XML – מה להכניס ומה לא

- Canonical מול 301 Redirect

- טעויות בשגיאות סטטוס שעולות ביוקר

- שרשראות Redirect וכיצד לפתור

- מבנה אתר וקישורים פנימיים

- Core Web Vitals – שלושה מספרים קריטיים

- שיפור מהירות אתר בצורה טכנית

- אתרים מבוססי JavaScript – האתגר הנסתר

- אתר רב-לשוני ו-hreflang

- פאג'ינציה ופרמטרים ב-URL

- מדידת הצלחה של SEO טכני

מה זה Technical SEO ומה בדיוק נכנס לתמונה?

Technical SEO הוא תחום בקידום אתרים שמתמקד בתשתית – הקוד, השרת, הפרוטוקולים ומבנה האתר. המטרה: לאפשר למנועי חיפוש לבצע שלוש פעולות קריטיות – סריקה (Crawling), רינדור (Rendering) ואינדוקס (Indexing) – בצורה חלקה ויעילה.

בניגוד ל-On-Page SEO שעוסק בתוכן העמוד עצמו, כאן מדובר על מה שקורה "מתחת למכסה המנוע". זה כולל טיפול בקובצי robots.txt ו-Sitemap, ניהול הפניות (Redirects), תגיות Canonical, מהירות טעינה, נתונים מובנים (Schema), וניהול כפילויות ושגיאות.

הגישה שלנו בהראל דיגיטל: קידום טכני הוא הצעד הראשון בכל פרויקט. לפני שנוגעים במילה אחת של תוכן, מוודאים שהתשתית מוכנה לקבל את התנועה ושגוגל יכול לסרוק ולאנדקס את האתר כמו שצריך.

למה SEO טכני חשוב גם כשהתוכן באתר מעולה?

דמיינו חנות עם מוצרים מצוינים, אבל הדלת נעולה וגוגל לא מוצא את הכניסה. זה בדיוק מה שקורה כשיש בעיה טכנית: התוכן הטוב בעולם לא יופיע בתוצאות חיפוש אם גוגל לא מצליח להגיע אליו.

הזנחה טכנית גורמת לדפים חשובים שלא נסרקים, לכפילויות שמדללות את כוח הדירוג, ולאיטיות שפוגעת בחוויית המשתמש ובשיעור ההמרה. בעידן שבו גוגל מתייחס לחוויית עמוד כפקטור ישיר – מהירות, יציבות ותגובתיות – התשתית הטכנית היא לא "נחמד שיש", אלא תנאי הכרחי לתחרות.

טיפ מקצועי: לפני שמשקיעים בתוכן חדש, בדקו ב-Google Search Console כמה מהדפים הקיימים באתר בכלל מאונדקסים. אם יש פער גדול בין מספר הדפים באתר למספר שגוגל מאנדקס – יש בעיה טכנית שצריך לפתור קודם.

ההבדל בין SEO טכני, On-Page ו-Off-Page

| תחום | מה הוא כולל | דוגמה מעשית |

|---|---|---|

| SEO טכני | תשתית, שרת, סריקה, מהירות, HTTPS, מבנה URL | תיקון שרשרת Redirects, שיפור LCP |

| On-Page SEO | תוכן, כותרות, מטא-תיאור, טקסט אלט, מילות מפתח | כתיבת Title ממוקד, אופטימיזציית כותרות H |

| Off-Page SEO | סמכות חיצונית, קישורים נכנסים, אזכורים | קישור ממאמר בפורטל חדשותי |

שלושת התחומים עובדים יחד, אבל SEO טכני הוא היסודות – בלי יסודות יציבים, גם קירות מהודרים לא יחזיקו.

רוצים לדעת אם התשתית הטכנית של האתר שלכם עובדת בשבילכם?

הצוות של הראל דיגיטל מבצע אודיט טכני מקיף וממפה את הפערים – כדי שכל שקל שאתם משקיעים בתוכן מגיע ליעד.

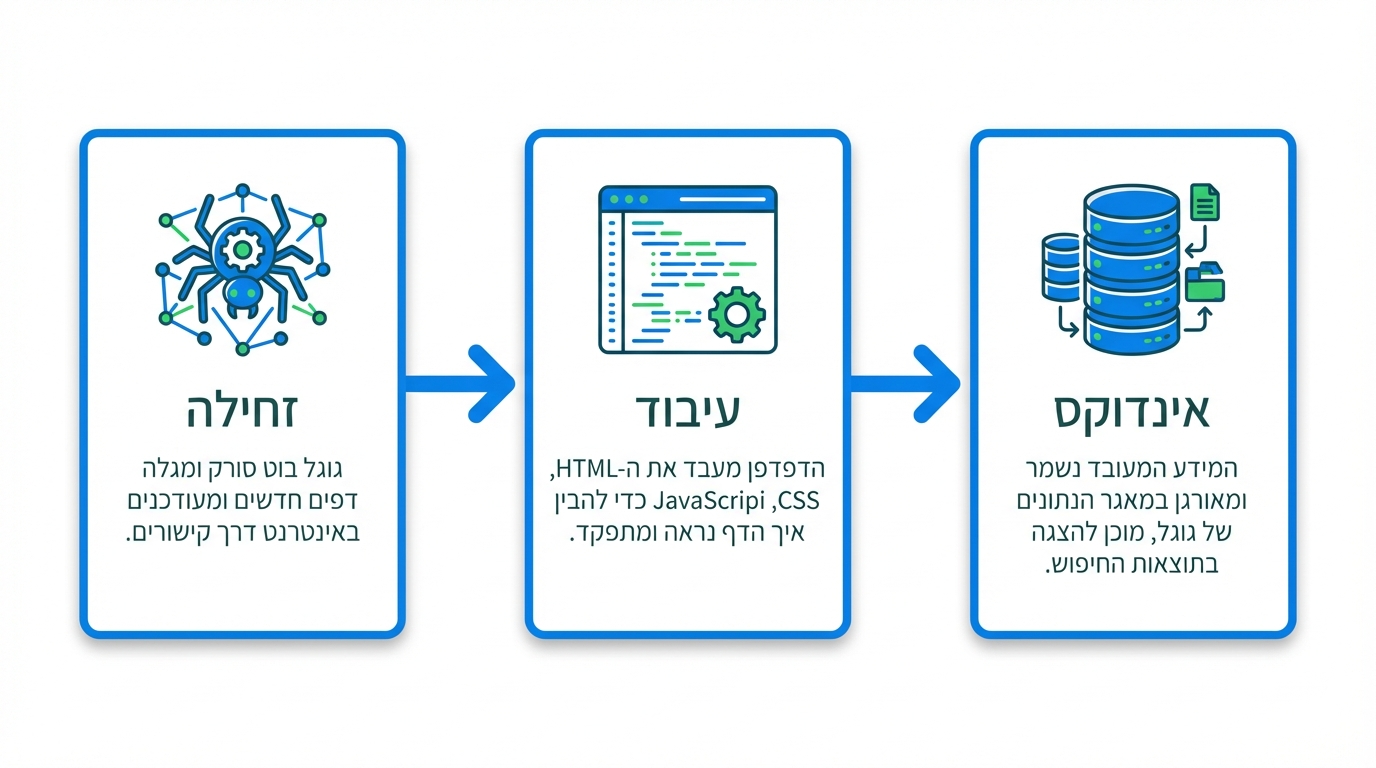

איך גוגל סורק, מרנדר ומאנדקס אתר בפועל?

התהליך מתחיל בגילוי: גוגל מוצא כתובת URL דרך קישור פנימי, חיצוני או Sitemap. בשלב הבא – סריקה – הבוט (Googlebot) מוריד את קוד ה-HTML של הדף.

אם הדף מכיל תוכן שמופיע רק לאחר הרצת JavaScript, נדרש שלב נוסף – רינדור – שבו גוגל מריץ את הקוד כדי "לראות" את הדף כפי שהמשתמש רואה אותו. רק אחרי כל השלבים האלה גוגל מחליט אם לאנדקס את הדף, כלומר לשמור אותו במאגר ולהציג אותו בתוצאות.

כפי שמתואר בתיעוד הרשמי של גוגל בנושא JavaScript SEO basics, רוב הבעיות הטכניות קורות בדיוק במעברים בין השלבים: חסימת סריקה מונעת רינדור, רינדור כושל מונע אינדוקס, ותוכן שנטען רק אחרי אינטראקציה פשוט לא קיים מבחינת גוגל.

נקודה חשובה: גוגל מפריד בין סריקה לרינדור – ולפעמים הרינדור מתבצע ימים אחרי הסריקה. תוכן שתלוי ב-JavaScript עלול לחכות זמן רב יותר עד שיתווסף לאינדקס.

אודיט Technical SEO – מאיפה מתחילים בלי להתבלבל?

אודיט טכני מסודר הוא המפתח לכל אופטימיזציה טכנית לאתר. הסדר משנה: אם מתחילים מכיוון לא נכון, מבזבזים שעות על תיקונים שלא מזיזים את המחט.

במסגרת שירותי קידום אתרים מקצועי בהראל דיגיטל, אנו מתחילים כל פרויקט באודיט מעמיק לפי סדר עדיפויות ברור:

- סריקה ונגישות – robots.txt, שגיאות שרת, חסימות

- אינדוקס – Sitemap, דפים יתומים, noindex שגוי

- כפילויות – Canonical, Redirects, גרסאות URL

- ביצועים – Core Web Vitals, מהירות טעינה

- מבנה אתר – היררכיה, קישורים פנימיים, עומק קליק

- נתונים מובנים – Schema Markup, Rich Results

ככה מוודאים שכל תיקון בונה על הקודם, במקום לטפל בסימפטומים בלי לפתור את הבעיה האמיתית.

איך יודעים אילו דפים גוגל באמת מאנדקס?

הכלי המרכזי הוא דוח Page Indexing ב-Google Search Console. שם רואים את הסטטוס של כל URL: האם הוא מאונדקס, נסרק אבל לא נכלל, או שגוגל בחר Canonical אחר.

שני סטטוסים שמצריכים תשומת לב מיוחדת:

- "Discovered – currently not indexed" – גוגל מצא את הדף אבל לא טרח לסרוק אותו. סימן אפשרי לחוסר חשיבות נתפסת או עומס על תקציב הסריקה.

- "Crawled – currently not indexed" – גוגל סרק אבל החליט שהתוכן לא מספיק טוב או שהדף כפול. כאן צריך לבחון את איכות התוכן ואת מבנה ה-Canonical.

טיפ מקצועי: השוו את מספר הדפים ב-Sitemap שלכם למספר הדפים המאונדקסים ב-Search Console. פער גדול מעיד על בעיה טכנית שדורשת חקירה – לא סתם "גוגל מתעלם".

מתי Crawl Budget באמת משנה – ומתי זה סתם באזוורד?

Crawl Budget מתאר את כמות המשאבים שגוגל מקצה לסריקת האתר שלכם. האמת? לאתרים קטנים (עד כמה מאות דפים) זה כמעט אף פעם לא הבעיה.

הנושא הופך לקריטי באתרי e-commerce עם אלפי מוצרים, פורטלים עם דפי פילטר אינסופיים, או אתרים עם שרת איטי שגורם לגוגל להאט סריקה.

גורמים שמבזבזים תקציב סריקה:

- שרשראות Redirect ולולאות הפניה

- כמות גדולה של דפי 404 עם קישורים פנימיים

- גרסאות URL עם פרמטרים חסרי ערך

- תוכן כפול בהיקף גדול ללא Canonical

הפתרון הוא לצמצם "רעש" ולוודא שגוגל מבלה את זמנו על דפים שבאמת חשובים לעסק שלכם.

הטעות הכי מסוכנת ב-Robots.txt – שאף אחד לא חושב שהוא עושה

Robots.txt הוא קובץ טקסט פשוט בשורש האתר שמנחה בוטים אילו אזורים לסרוק ואילו לא. נקודה קריטית שהרבה אנשים מפספסים: זו הנחיה לסריקה בלבד, לא לאינדוקס.

דף שחסום ב-robots.txt עדיין יכול להופיע בתוצאות גוגל (בלי תוכן) אם יש אליו קישורים. כפי שמפורט בתיעוד הרשמי של גוגל, robots.txt הוא כלי לניהול עומס סריקה – לא מנגנון אבטחה ולא תחליף ל-noindex.

הטעות המסוכנת ביותר: חסימה של תיקיות CSS ו-JavaScript שמונעת מגוגל לרנדר את האתר כראוי, או חסימה בטעות של אזורי תוכן שלמים באמצעות Disallow: /. בדקו את הקובץ שלכם עכשיו – טעות אחת יכולה להסתיר את כל האתר מגוגל.

לא בטוחים שה-Robots.txt שלכם תקין?

נבדוק את הקובץ ונוודא שגוגל סורק בדיוק מה שצריך

Sitemap XML – מה להכניס ומה לא

מפת אתר (Sitemap XML) היא רשימה שמאותתת לגוגל אילו דפים חשובים לכם. כלל האצבע: אם דף לא ראוי להופיע בתוצאות חיפוש, הוא לא צריך להיות ב-Sitemap.

הכניסו רק דפים עם סטטוס 200 שאתם רוצים שגוגל יאנדקס – כלומר דפים קנוניקליים, ללא תגית noindex. אל תכללו:

- דפים עם הפניות (301/302)

- דפי שגיאה (404)

- דפים כפולים או דפי פרמטרים לא רצויים

- דפים עם תגית noindex

Sitemap תקין ונקי עוזר לגוגל לגלות תוכן חדש מהר יותר, במיוחד באתרים גדולים שבהם לא כל הדפים מקושרים היטב.

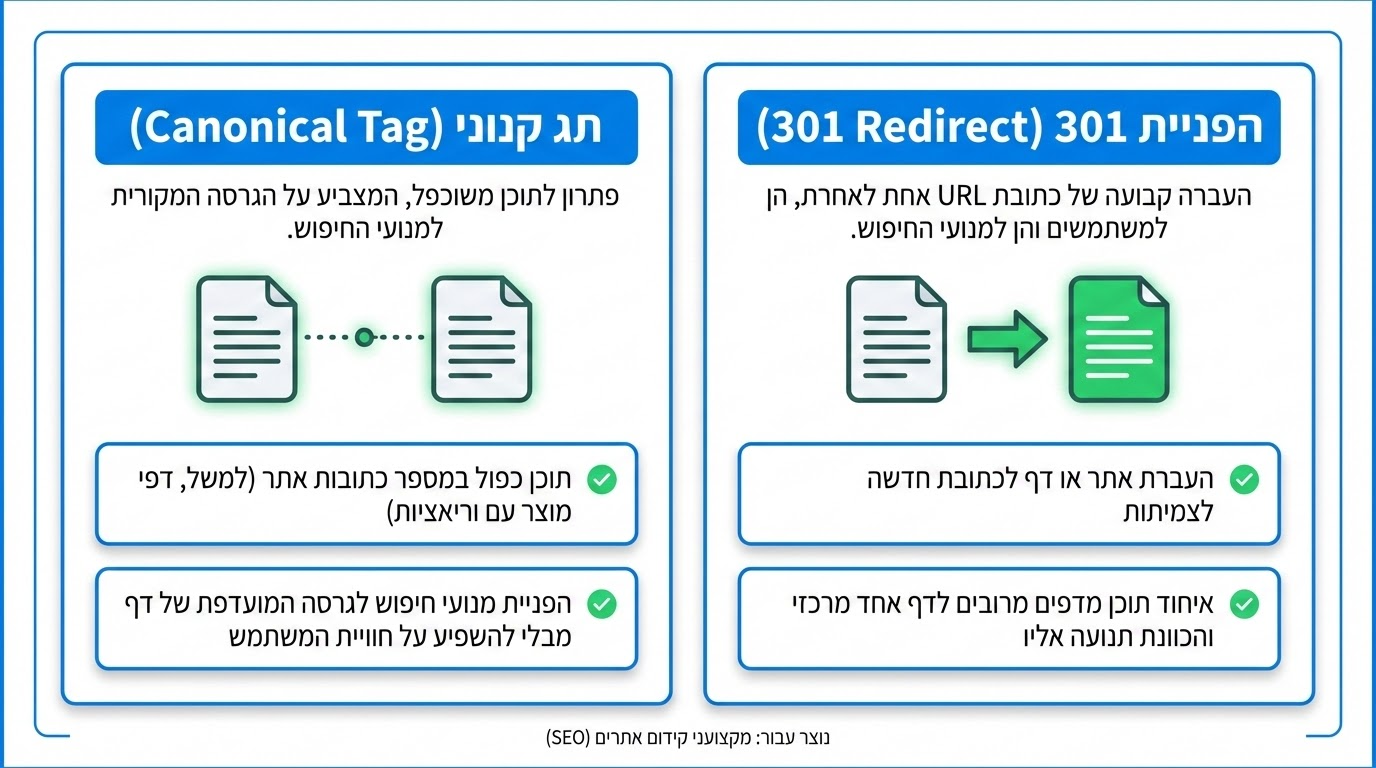

Canonical מול 301 Redirect – תרחישים שמבהירים את הבחירה

הבלבול בין Canonical ל-301 הוא אחת הטעויות הנפוצות ביותר. הנה ההבדל המעשי:

- 301 מעביר פיזית – המשתמש והבוט מגיעים לדף אחר, והדף הישן "נעלם" לטובת החדש.

- Canonical משאיר שני הדפים נגישים – אבל אומר לגוגל: "בבקשה, התייחס לדף הזה כמקור".

מתי בוחרים מה? אם הדף הישן לא רלוונטי יותר ואין סיבה שמשתמש יראה אותו – 301 עדיף. אם יש צורך בגרסאות מקבילות (למשל מוצר שזמין בצבעים שונים עם URL נפרד, או פרמטרים שימושיים למשתמש) – Canonical מתאים יותר, בהתאם להנחיות גוגל לאיחוד כתובות כפולות.

מתי noindex עדיף על Canonical?

כשיש דף שלא רוצים שיופיע בגוגל בכלל – למשל דף תודה, דף מדיניות פרטיות או דף תוצאות חיפוש פנימי – noindex הוא הכלי הנכון. Canonical לא מסיר דף מהאינדקס, הוא רק מכוון לדף המועדף. אם המטרה היא "שדף הזה לא יהיה בגוגל", השתמשו ב-noindex ולא ב-Canonical.

למה גוגל מתעלם מה-Canonical שהגדרתם?

רואים ב-Search Console את ההודעה "Duplicate, Google chose different canonical than user"? זה אומר שגוגל מתייחס ל-Canonical כהמלצה בלבד – ואם הוא מזהה אותות סותרים, הוא יבחר בעצמו.

מה גורם לזה? קישורים פנימיים שמצביעים על גרסה אחת אבל ה-Canonical מכוון לאחרת; ה-Sitemap מכיל URL שונה מהקנוניקל; או חוסר עקביות בסלאש, אותיות גדולות/קטנות ופרמטרים. הפתרון: ליצור עקביות מלאה – הקישורים הפנימיים, ה-Sitemap וה-Canonical צריכים כולם להצביע לאותו URL בדיוק.

טיפ מקצועי: בדקו ב-Search Console בדוח Page Indexing את הסינון "Duplicate, Google chose different canonical than user". אם יש שם דפים חשובים – זה סימן שצריך לטפל בעקביות הקנוניקל לפני כל דבר אחר.

טעויות בשגיאות סטטוס שעולות ביוקר

לא כל שגיאת 404 היא בעיה. אם דף הוסר בכוונה ואין לו תחליף, 404 הוא תקין לגמרי. אבל כשיש קישורים פנימיים שמפנים לדף שכבר לא קיים – זה בזבוז של תקציב סריקה ופגיעה בחוויית המשתמש.

- שגיאות 500 ו-503 (שגיאות שרת) – דחופות הרבה יותר: הן גורמות לגוגל להאט את הסריקה ומעידות על תקלה טכנית.

- קוד 410 (Gone) – מאותת לגוגל שהדף הוסר לצמיתות ואפשר להוציא אותו מהאינדקס מהר יותר מאשר 404 רגיל.

מה אנו עושים: אחד הדברים שאנו מבצעים בהראל דיגיטל במסגרת ניהול ואחסון אתרים הוא ניטור שוטף של שגיאות שרת – כדי לזהות ולתקן תקלות לפני שהן מספיקות לפגוע בסריקה ובדירוג.

שרשראות Redirect: איך "קפיצה אחת" חוסכת בעיות

שרשרת הפניה (Redirect Chain) נוצרת כשדף A מפנה ל-B ו-B מפנה ל-C. כל "קפיצה" מוסיפה עיכוב בטעינה, מבזבזת תקציב סריקה ועלולה לגרום לאיבוד קל של כוח קידום.

במקרה קיצוני של Redirect Loop – כשה-A מפנה ל-B ו-B חוזר ל-A – הדפדפן נתקע לחלוטין.

301 מול 302 – הבחירה משנה: 301 הוא מעבר קבוע שמעביר כוח קידום. 302 הוא מעבר זמני שגורם לגוגל לשמור את ה-URL הישן באינדקס. הטעות הנפוצה: שימוש ב-302 כשבפועל המעבר הוא קבוע – למשל אחרי מיגרציה. כלל פשוט: אם הכתובת השתנתה לתמיד – 301. אם זו הפניה זמנית – 302.

התיקון פשוט ברמה הקונספטואלית אך דורש מיפוי שיטתי: לעדכן את כל ההפניות כך שכל URL ישן יפנה ישירות ליעד הסופי בקפיצה אחת בלבד.

שרשראות Redirect מאטות את האתר ופוגעות בדירוג

נמפה את כל ההפניות באתר שלכם ונתקן אותן – כדי שכל URL יגיע ליעד בקפיצה אחת

מבנה אתר וקישורים פנימיים – התשתית שגוגל קורא כמו מפה

מבנה האתר הוא הדרך של גוגל להבין מה חשוב ומה פחות. עומק הקלקה (Click Depth) קובע כמה קליקים נדרשים כדי להגיע לדף ממסך הבית – כלל אצבע: כל דף חשוב צריך להיות נגיש בתוך 3 קליקים לכל היותר.

קישורים פנימיים הם מנגנון חלוקת הכוח: דף שמקבל הרבה קישורים פנימיים נתפס כחשוב יותר. דפים "יתומים" (Orphan Pages) – כאלה שאין אליהם שום קישור פנימי – כמעט בלתי נראים לגוגל.

שימוש ב-Breadcrumbs (פירורי לחם) משפר גם את חוויית המשתמש וגם את ההבנה של ההיררכיה על ידי מנועי החיפוש.

טיפ מקצועי: הריצו סריקה עם כלי כמו Screaming Frog וסננו דפים עם 0 קישורים פנימיים נכנסים. כל דף כזה הוא דף "יתום" שגוגל כנראה לא מכיר – ותיקון מהיר של קישור פנימי אחד יכול להכניס אותו לאינדקס.

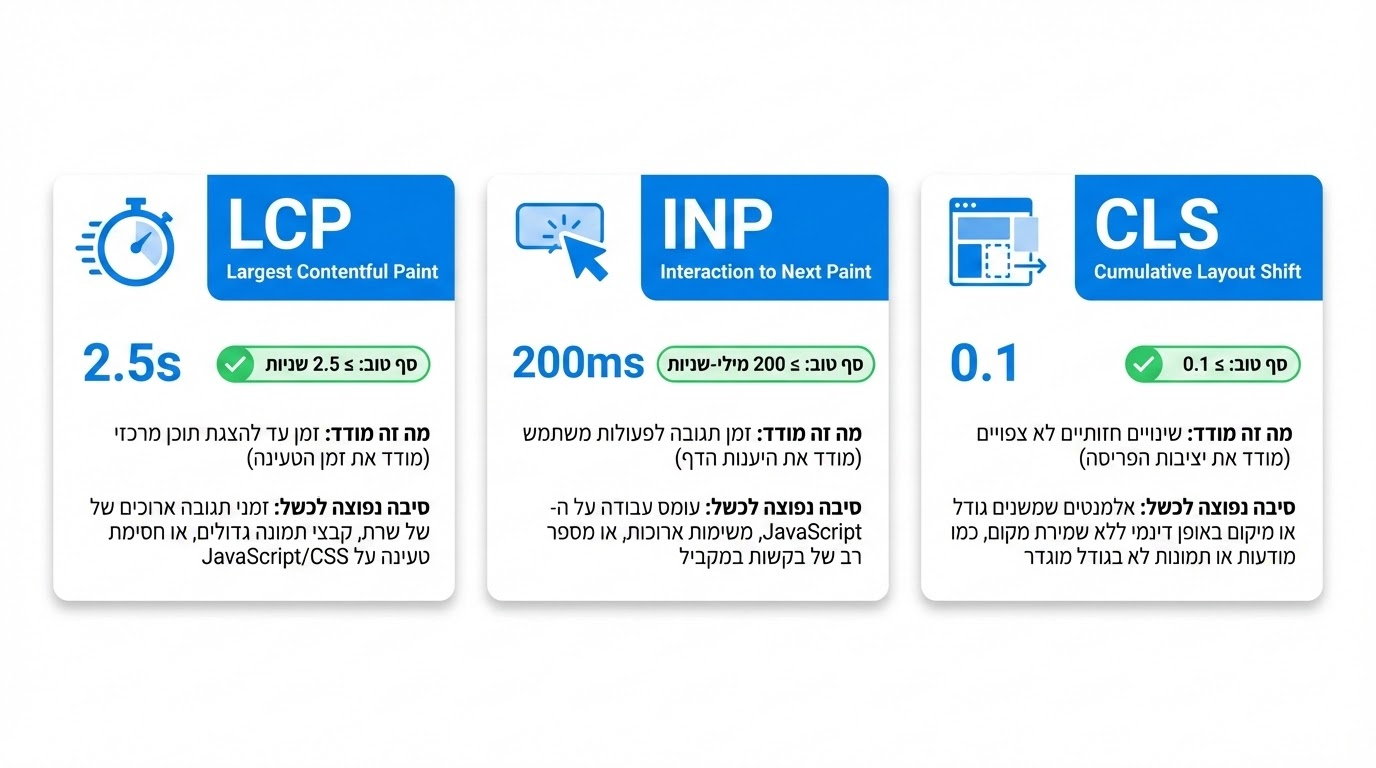

Core Web Vitals – שלושה מספרים שמשפיעים על הדירוג והמכירות

| מדד | מה הוא מודד | סף "טוב" | גורם שכיח לבעיה |

|---|---|---|---|

| LCP | מהירות טעינת האלמנט הכי גדול על המסך | עד 2.5 שניות | תמונות כבדות, שרת איטי, חסימת רינדור |

| INP | מהירות תגובה ללחיצה/אינטראקציה | עד 200 מילישניות | JavaScript כבד, משימות ארוכות ב-Main Thread |

| CLS | יציבות חזותית – כמה אלמנטים "קופצים" | עד 0.1 | תמונות ללא ממדים, פונטים חיצוניים, מודעות |

שלושת המדדים האלה הם חלק מחוויית העמוד שגוגל מודד כפקטור ישיר בדירוג, כפי שמפורט במדריך Core Web Vitals של גוגל. שיפור שלהם דורש עבודת קוד אמיתית – לא תוסף קסם – וההשפעה מורגשת גם בדירוג וגם בשיעור ההמרה.

שיפור מהירות אתר בצורה טכנית – בלי הבטחות קוסמים

מהירות היא לא רק "חוויית משתמש נעימה" – היא משפיעה ישירות על כמה אנשים נשארים באתר, על שיעור ההמרה ועל הדירוג. הנה מה שבאמת עובד:

- אופטימיזציית תמונות – פורמט WebP, דחיסה, ממדים מוגדרים מראש

- צמצום וקיצור קבצי CSS ו-JavaScript (Minification)

- שימוש ב-Caching ברמת שרת ודפדפן

- פריסה על CDN שמגיש תכנים סטטיים מנקודות קרובות למשתמש

- Lazy Loading לתמונות שנמצאות מתחת לקו הנראה

- הימנעות מסקריפטים חוסמי-רינדור בראש הדף

כל שיפור נמדד – לפני ואחרי – כדי לוודא שהשינוי באמת הזיז את המדדים.

האתר שלכם נטען יותר מ-3 שניות?

נבדוק את המהירות, נאתר את החסמים ונשפר את הביצועים

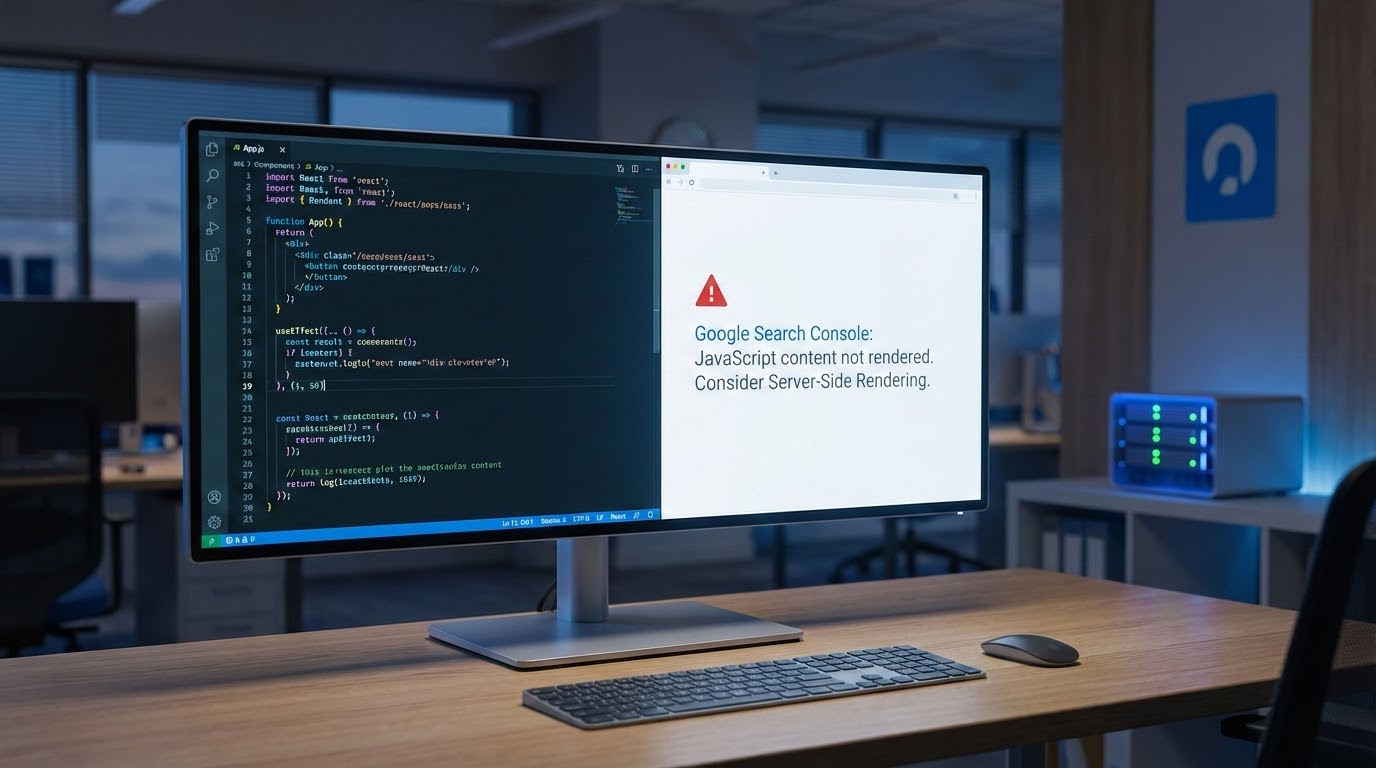

אתרים מבוססי JavaScript – האתגר שמפתחים רבים מתעלמים ממנו

אם האתר שלכם בנוי על React, Angular, Vue או כל פריימוורק JavaScript – יש אתגר ייחודי: גוגלבוט לא תמיד מריץ JS בצורה מושלמת או מיידית. תוכן שנטען רק אחרי אינטראקציה (לחיצה, גלילה) עלול לא להיות גלוי כלל לגוגל.

הפתרון המומלץ היום הוא Server Side Rendering (SSR) – כשהשרת מגיש HTML מוכן שלא תלוי בהרצת JavaScript בצד הלקוח. Static Rendering (בנייה מראש של דפים סטטיים) הוא אופציה נוספת.

גוגל עצמם ציינו ש-Dynamic Rendering הוא workaround שכבר פחות מומלץ, ועדיפים פתרונות SSR מלאים. עסקים שמפעילים אתרי SPA (Single Page Application) חייבים לוודא שהתוכן הקריטי מוגש בצורה שגוגל יכול לקרוא – אחרת הם משקיעים בתוכן שאף אחד לא רואה.

אתר רב-לשוני ו-hreflang – חוקים שאסור להפר

אם האתר שלכם פונה לקהלים בשפות שונות או במדינות שונות, תגית hreflang היא ההנחיה שאומרת לגוגל: "העמוד הזה קיים גם בגרסה אחרת, הצג את הגרסה הנכונה למשתמש הנכון."

שלושה כללים קריטיים:

- כל דף חייב להכיל תגית שמפנה לעצמו (self-reference)

- אם דף A בעברית מפנה לדף B באנגלית, דף B חייב להפנות חזרה ל-A (דו-כיווניות)

- יש להגדיר x-default כדי שגוגל ידע מה להציג למשתמשים שאין להם גרסה מדויקת

חשוב לדעת: הפרת אחד מהכללים האלה גורמת לגוגל להתעלם מהתגיות לחלוטין. בדקו עקביות מלאה בין כל הגרסאות – טעות אחת בדף אחד יכולה לפגוע בכל המערך הרב-לשוני.

פאג'ינציה ופרמטרים ב-URL – כשאלפי כתובות הופכות לבעיה

באתרי מסחר אלקטרוני ופורטלי תוכן, עמודי קטגוריה עם עשרות עמודים של תוצאות, פילטרים ומיונים יוצרים אלפי וריאציות URL. גוגל לרוב סורק רק קישורים שמופיעים כ-a href סטנדרטי – כפתורי "טען עוד" שפועלים ב-JavaScript בלבד עלולים לחסום סריקה לחלוטין.

הפתרון:

- לוודא שלכל עמוד פאג'ינציה יש URL ייחודי וקישור HTML תקני

- להשתמש ב-Canonical שמפנה לעמוד הקטגוריה הראשי כדי למנוע כפילויות מפרמטרים

- למנוע מדפי פילטר להיכנס ל-Sitemap

כך תקציב הסריקה מנוצל על דפים שבאמת חשובים.

מדידת הצלחה של SEO טכני – מה באמת כדאי לעקוב אחריו?

שיפורים טכניים צריכים להיות מדידים. הנה המדדים שמשנים:

- כמות הדפים המאונדקסים לעומת הכמות הרצויה (דוח Page Indexing ב-GSC)

- זמן טעינה ממוצע וציוני Core Web Vitals (Google PageSpeed Insights ודוח CWV ב-GSC)

- שגיאות סריקה חדשות לעומת ישנות

- מספר דפים עם חסימות או Canonical שגוי

בהראל דיגיטל אנו מגדירים מראש KPI טכניים לכל פרויקט – לא סתם "לתקן הכל" אלא לתעדף לפי השפעה עסקית: כמה תנועה אורגנית נוספת צפויה אם נתקן את הבעיה, וכמה הכנסה זה מייצג.

טיפ מקצועי: SEO טכני הוא לא משימה חד-פעמית אלא תהליך מתמשך. האתר שלכם חי ונושם – דפים מתווספים, קוד משתנה, גוגל מעדכן אלגוריתמים. ניטור קבוע ב-Search Console ואודיט טכני אחת לרבעון מוודאים שאתם לא מפספסים בעיות חדשות.

רוצים לדעת מה בדיוק צריך לתקן באתר שלכם?

הצוות של הראל דיגיטל מבצע אודיט טכני מקיף, ממפה את הפערים ובונה תוכנית עבודה מסודרת – כך שכל שקל שאתם משקיעים בתוכן ובקמפיינים מגיע ליעד.

מה הלקוחות שלנו אומרים

ביקורות אמיתיות מלקוחות מרוצים

שאלות נפוצות