בעלי עסקים רבים משקיעים אלפי שקלים בחודש על תוכן, קישורים וקמפיינים – אבל שוכחים לבדוק אם גוגל בכלל מצליח להיכנס לאתר, להבין אותו ולהציג אותו בתוצאות. SEO טכני (Technical SEO) הוא המפתח שמוודא שהתשתית הדיגיטלית שלכם עובדת בשביל מנועי החיפוש ולא נגדם. במדריך המקיף הזה נפרק את כל הנושא לשלבים ברורים וישימים.

- מהו Technical SEO ולמה הוא הבסיס לכל הצלחה בגוגל?

- זחילה ואינדוקס – השער של גוגל לאתר שלכם

- תקציב זחילה – למה גוגל לא סורקת הכול?

- שליטה באינדוקס: noindex, canonical ואיפה הטעויות מסתתרות

- קודי סטטוס HTTP ושרשראות הפניה

- ארכיטקטורת אתר – למה המבנה חשוב לא פחות מהתוכן?

- Core Web Vitals: כשחוויית המשתמש הופכת לגורם דירוג

- כיצד מבצעים Technical SEO Audit – צ'ק-ליסט מעשי

- נתונים מובנים, מובייל ואבטחה

- האם כדאי לעשות SEO טכני לבד או עם מומחה?

מהו Technical SEO ולמה הוא הבסיס לכל הצלחה בגוגל?

Technical SEO, או בעברית – קידום טכני, הוא מכלול הפעולות שמטרתן להבטיח שמנועי חיפוש יוכלו לסרוק את האתר שלכם, לאנדקס את הדפים שלו ולהבין את המבנה והתוכן ללא הפרעות. חשבו על זה כמו בניית בית: התוכן הוא העיצוב והריהוט, הקישורים החיצוניים הם ההמלצות מהשכנים, אבל הקידום הטכני הוא היסודות, הצנרת והחשמל. אם היסודות רעועים – לא משנה כמה יפה העיצוב, הבית לא יחזיק מעמד.

אופטימיזציה טכנית לאתר כוללת טיפול בזחילה ואינדוקס, ניהול הפניות, שיפור מהירות טעינה, ארכיטקטורת אתר נכונה, התאמה למובייל, אבטחה ונתונים מובנים. מדובר בתחום שמשתנה תדיר – גוגל מעדכנת את הדרישות הטכניות שלה באופן שוטף, ומה שהיה תקין לפני שנה עלול להפוך לבעייתי היום. לכן כל פרויקט קידום רציני מתחיל מביקורת טכנית, לפני שבכלל נוגעים בתוכן או בקמפיינים.

עיקרון מנחה: SEO טכני הוא לא פרויקט חד-פעמי – הוא תהליך מתמשך. כל שינוי באתר, מעבר פלטפורמה או עדכון גדול דורש בדיקה טכנית מחדש כדי לוודא שלא נוצרו בעיות חדשות.

זחילה ואינדוקס – השער של גוגל לאתר שלכם

ההבדל בין זחילה (Crawling) לאינדוקס (Indexing) הוא קריטי. זחילה היא השלב שבו הבוט של גוגל (Googlebot) מגלה דפים באתר ו"קורא" אותם. אינדוקס הוא השלב שבו גוגל שומרת את הדף במאגר שלה ומסוגלת להציג אותו בתוצאות חיפוש. דף שנסרק לא בהכרח ייכנס לאינדקס – ולהפך, דף שלא נסרק בכלל לא יופיע בשום תוצאת חיפוש.

קובץ Robots.txt – שומר הסף

קובץ robots.txt הוא קובץ טקסט פשוט שנמצא בשורש האתר ואומר לבוטים היכן מותר לבקר והיכן אסור. הבעיה: טעות קטנה בקובץ הזה יכולה לחסום את האתר כולו מסריקה. דוגמה נפוצה – חסימה רחבה מדי באמצעות Disallow: / שמונעת גישה לכל הדפים, או חסימת תיקיות שמכילות קבצי CSS ו-JavaScript שגוגל צריכה כדי לרנדר עמודים כראוי. חשוב לדעת שחסימה ב-robots.txt מונעת סריקה אך לא מונעת הופעה באינדקס.

מפת אתר XML – כלי גילוי, לא כלי כפייה

מפת אתר (XML Sitemap) היא רשימה של כתובות URL חשובות שאתם רוצים שגוגל תגלה. היא לא "מכריחה" אינדוקס – אבל משפרת משמעותית את הגילוי, במיוחד באתרים גדולים או חדשים. הכלל: לכלול רק עמודים תקינים (סטטוס 200), קנוניים, שמיועדים לאינדוקס. אין לכלול הפניות, עמודים חסומים או כפילויות. גוגל מתעלמת מערכי priority ו-changefreq ומשתמשת בערך lastmod רק כשהוא עקבי ומדויק.

טיפ מקצועי: בדקו את קובץ ה-robots.txt שלכם עכשיו – פשוט הקלידו את כתובת האתר ואחריו /robots.txt. אם אתם רואים Disallow: / בלי User-agent ספציפי, יש סיכוי טוב שגוגל חסומה מלסרוק את כל האתר.

תקציב זחילה – למה גוגל לא סורקת הכול?

תקציב זחילה (Crawl Budget) הוא המושג שמתאר כמה דפים גוגל מוכנה ויכולה לסרוק באתר שלכם בפרק זמן נתון. המושג רלוונטי בעיקר לאתרים עם אלפי דפים, אבל גם אתרים קטנים יותר סובלים מהשלכות של ניהול לא נכון. כשגוגל מבזבזת את תקציב הזחילה על עמודים חסרי ערך – פרמטרים אינסופיים, עמודי סינון כפולים, או דפים עם תוכן דל – היא מגיעה פחות לעמודים שבאמת חשובים לכם.

ניהול Crawl Budget מורכב משני מרכיבים: הקיבולת שגוגל מוכנה להקצות (Crawl Capacity Limit) והביקוש לסריקה (Crawl Demand). כדי לשפר, מצמצמים עמודי זבל מהאינדקס, מתקנים שגיאות שרת חוזרות ומוודאים שהאתר מגיב מהר. כשהאתר "נקי" וממוקד – גוגל סורקת יותר ממה שחשוב.

חושדים שגוגל לא סורקת עמודים חשובים?

אודיט טכני יחשוף בדיוק איפה הבעיה ואיך לתקן אותה

שליטה באינדוקס: noindex, canonical ואיפה הטעויות מסתתרות

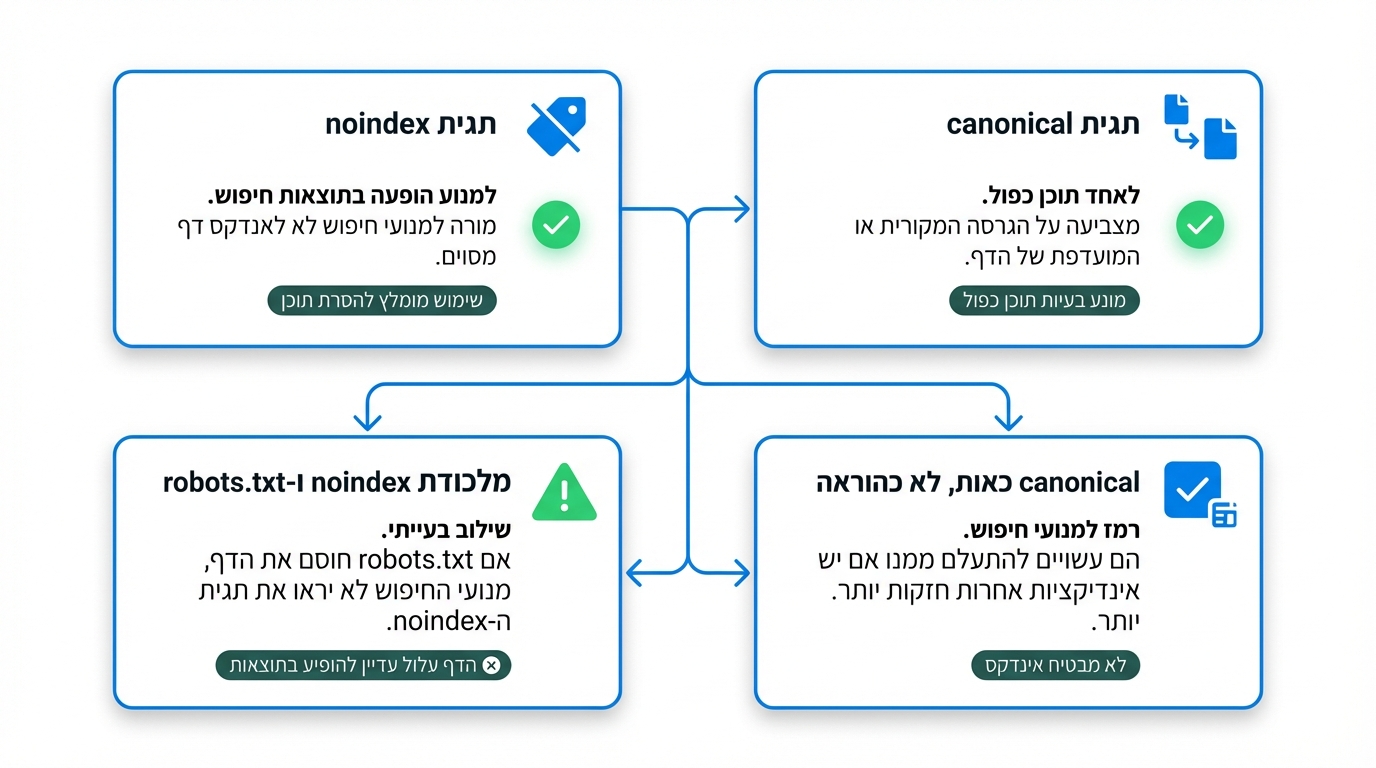

לא כל עמוד באתר צריך להיכנס לאינדקס של גוגל. עמודי תודה, תוצאות חיפוש פנימיות, עמודי מדיניות פרטיות ועמודי סינון לא איכותיים – כולם "מלכלכים" את האינדקס ומדללים את הכוח של העמודים החשובים. תגית noindex היא הפתרון: היא אומרת לגוגל "אל תשמור את הדף הזה באינדקס". אבל יש כאן מלכוד – כדי שגוגל תקרא את הנחיית noindex, היא חייבת לסרוק את העמוד. אם חסמתם את העמוד גם ב-robots.txt, גוגל לא תגיע אליו ולא תראה את ההנחיה.

תגית canonical פותרת בעיה אחרת: תוכן כפול. כשאותו תוכן נגיש דרך כתובות שונות (פרמטרים, קטגוריות שונות, גרסאות הדפסה) – תגית canonical מצביעה על "הגרסה המועדפת" ומרכזת את כוח הקידום במקום אחד. גוגל מתייחסת ל-canonical כאות (Signal), לא כפקודה מוחלטת, אך שימוש עקבי ונכון חוסך בעיות רבות.

טעויות קלאסיות בשימוש בתגיות canonical ו-noindex

| טעות | מה קורה בפועל | הפתרון |

|---|---|---|

| noindex + חסימה ב-robots.txt | גוגל לא רואה את ההנחיה – העמוד עלול להישאר באינדקס | להסיר את החסימה ב-robots.txt ולהשאיר רק noindex |

| canonical שמצביע על עמוד עם noindex | סתירה: גוגל מקבלת אות "תאנדקס" ובמקביל "אל תאנדקס" | canonical חייב להצביע על עמוד שמיועד לאינדוקס |

| canonical שונה בין HTML לבין כותרת HTTP | בלבול אותות – גוגל תבחר לבד ולא תמיד נכון | לוודא עקביות מוחלטת בין כל שיטות ה-canonical |

| כל עמוד מצביע על עצמו גם כשיש כפילויות | גוגל לא מבינה מהי הגרסה המועדפת | לבחור גרסה אחת מועדפת ולהפנות את הכפילויות אליה |

שימו לב: שימוש ב-noindex דורש שהעמוד יהיה נגיש לזחילה. אם חסמתם אותו גם ב-robots.txt – גוגל פשוט לא תראה את ההנחיה, והעמוד עלול להישאר באינדקס בניגוד לכוונתכם.

קודי סטטוס HTTP ושרשראות הפניה

הפניות 301 לעומת 302

הפניית 301 היא קבועה – היא אומרת לגוגל "העמוד הזה עבר לצמיתות לכתובת חדשה, תעביר את כל האותות לשם." הפניית 302 היא זמנית – "העמוד כרגע מנותב למקום אחר, אבל אולי יחזור." בפועל, שימוש שגוי ב-302 כשההפניה קבועה עלול לעכב את העברת כוח הקידום ולגרום לגוגל לשמור על הכתובת הישנה באינדקס במקום החדשה. כלל אצבע: שינוי כתובת קבוע – תמיד 301. ניסוי זמני או תחזוקה קצרה – 302.

שגיאות 404 ו-Soft 404

שגיאת 404 (עמוד לא נמצא) היא מצב טבעי שקורה בכל אתר. הבעיה מתחילה כשיש הרבה קישורים פנימיים שמובילים ל-404, כי זה מבזבז תקציב זחילה ופוגע בחוויית המשתמש. Soft 404 זו בעיה חמורה יותר: עמוד שמרגיש כמו שגיאה אבל מחזיר קוד 200 (תקין). גוגל מזהה את זה ומסמנת את העמוד כבעייתי. הפתרון: להחזיר סטטוס 404 אמיתי כשתוכן לא קיים, ולתקן קישורים פנימיים שבורים.

שרשראות הפניה – הנזק הנסתר

שרשרת הפניה (Redirect Chain) נוצרת כשכתובת A מפנה ל-B, ש-B מפנה ל-C, ולפעמים גם ל-D. כל קפיצה כזו מוסיפה זמן טעינה ומבזבזת תקציב זחילה. לולאת הפניה (Redirect Loop) – כשכתובת A מפנה ל-B ו-B חוזרת ל-A – חוסמת לחלוטין את הגישה לתוכן. הפתרון: לסרוק את האתר עם כלי Audit, לאתר שרשראות ולקצר אותן להפניה יחידה.

טיפ מקצועי: לפני כל מעבר פלטפורמה או שינוי מבנה כתובות – מפו את כל ה-URL הישנות ותכננו הפניות 301 ישירות ליעד הסופי. כך תמנעו שרשראות הפניה ואובדן כוח קידום.

האתר שלכם עבר שינוי מבני לאחרונה?

בדיקת הפניות שגויות יכולה לחסוך חודשים של ירידה בתנועה. צרו קשר ונבדוק יחד.

ארכיטקטורת אתר – למה המבנה חשוב לא פחות מהתוכן?

ארכיטקטורת אתר נכונה עוזרת גם לגוגל וגם למשתמשים להגיע לעמודים החשובים מהר. כלל האצבע: עמודים עסקיים מרכזיים (שירותים, מוצרים, עמודי נחיתה) לא צריכים להיות במרחק של יותר מ-3 קליקים מדף הבית. כשעמוד "קבור" עמוק – גוגל מבינה שהוא פחות חשוב, וסורקת אותו בתדירות נמוכה יותר.

בעיה נפוצה היא עמודים יתומים (Orphan Pages) – דפים שאין אליהם שום קישור פנימי. גוגל מתקשה למצוא אותם, ואפילו אם הם מופיעים במפת האתר, הם מקבלים חשיבות נמוכה. לכן מערכת קישורים פנימיים חכמה – קישורים מעמודי Hub לעמודים עסקיים, שימוש בטקסט עוגן תיאורי, ופירורי לחם (Breadcrumbs) – היא חלק בלתי נפרד מ-Technical SEO.

כלל אצבע: כל עמוד שאתם רוצים שיקבל תנועה מגוגל צריך להיות נגיש בתוך 3 קליקים מדף הבית, עם לפחות קישור פנימי אחד שמוביל אליו מעמוד רלוונטי.

פרמטרים, פילטרים ועמודי סינון

אתרי מסחר ואתרים עם מערכות סינון יוצרים לעיתים מאות ואלפי כתובות URL שונות שמובילות לתוכן כמעט זהה. גוגל סורקת את כולן, מבזבזת תקציב זחילה, ומתקשה להבין מה באמת חשוב. התוצאה: "ניפוח אינדקס" (Index Bloat) שמדלל את כוח הקידום. הפתרון דורש החלטה מושכלת: אילו וריאציות שוות אינדוקס ואילו לא. על הווריאציות שלא שוות אינדוקס מיישמים canonical לעמוד הראשי, או noindex, ומצמצמים קישורים פנימיים אליהן.

Core Web Vitals: כשחוויית המשתמש הופכת לגורם דירוג

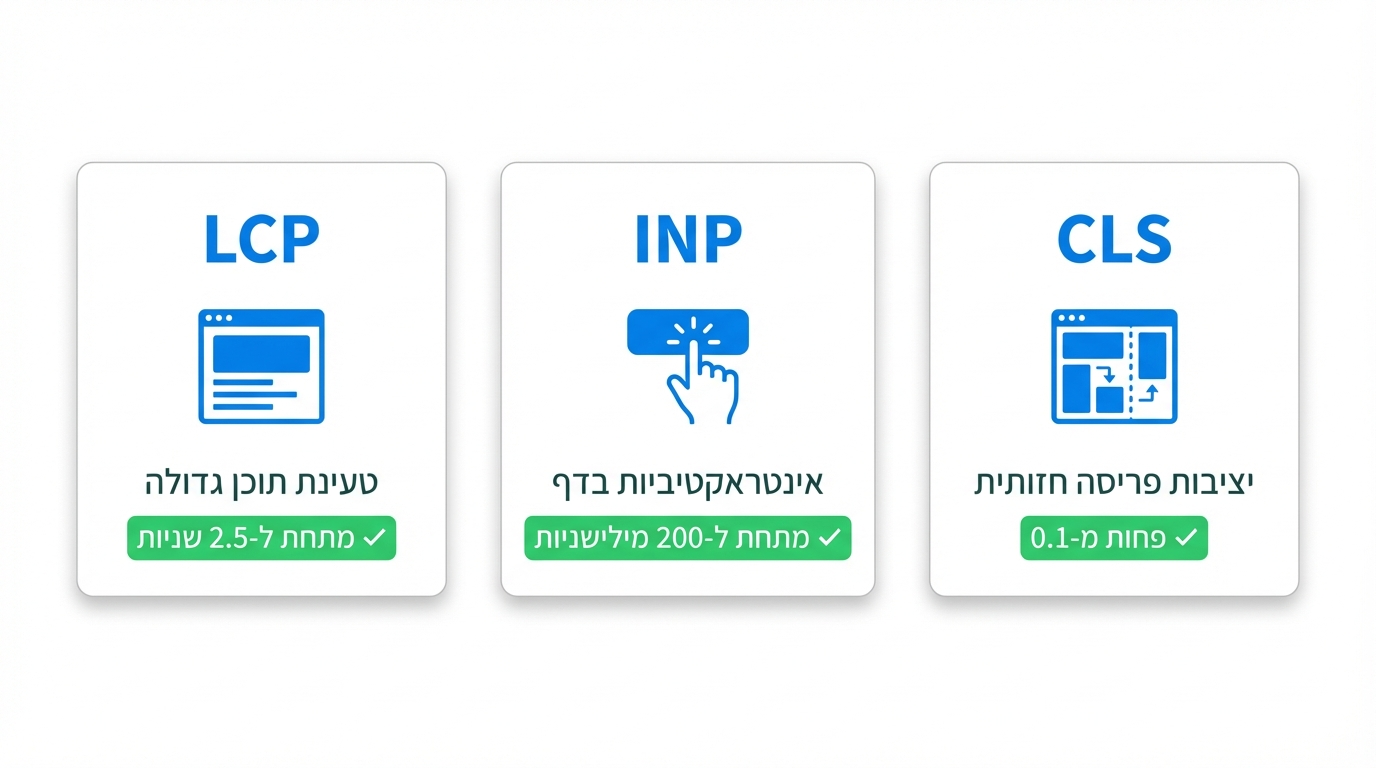

גוגל מודדת את איכות החוויה הטכנית באתר באמצעות שלושה מדדים מרכזיים שנקראים Core Web Vitals. אלה לא רק "מדדים טכניים" – הם משקפים את מה שהמשתמש מרגיש: האם העמוד נטען מהר? האם אפשר ללחוץ על כפתורים בלי לחכות? האם הדברים לא זזים בזמן הטעינה?

| מדד | מה הוא מודד | יעד מומלץ | גורמים נפוצים לחריגה |

|---|---|---|---|

| LCP (Largest Contentful Paint) | זמן טעינת האלמנט הגדול ביותר | עד 2.5 שניות | תמונות כבדות, שרת איטי, משאבים חוסמים |

| INP (Interaction to Next Paint) | מהירות תגובה לאינטראקציה | עד 200 מילישניות | JavaScript כבד, משימות ארוכות בדפדפן |

| CLS (Cumulative Layout Shift) | יציבות ויזואלית – כמה אלמנטים "זזים" | מתחת ל-0.1 | תמונות ללא מידות, פונטים, מודעות דינמיות |

איך משפרים LCP בפועל?

LCP מודד את הזמן שלוקח לאלמנט הגדול ביותר בחלק העליון של העמוד להיטען. שיפור LCP מתחיל בזמן תגובת השרת (TTFB) – אם השרת איטי, הכול מתעכב. לאחר מכן מטפלים בתמונות: דחיסה, פורמטים מודרניים כמו WebP או AVIF, הגדרת מידות מפורשות, ושימוש ב-fetchpriority="high" לתמונה הקריטית. פעולה נוספת: הסרת משאבים חוסמי רינדור, שימוש ב-CDN וטעינה עצלה רק לאלמנטים שמתחת לקו הקיפול.

INP – המדד שהחליף את FID

מדד INP (Interaction to Next Paint) החליף את FID כ-Core Web Vital ב-12 במרץ 2024. בעוד FID מדד רק את ההשהיה הראשונה, INP מודד את התגובתיות לאורך כל הביקור – כל לחיצה, כל הקלדה, כל אינטראקציה. הגורם המרכזי ל-INP חלש הוא JavaScript כבד: יותר מדי קוד, משימות ארוכות שחוסמות את ה-Main Thread, וספריות צד שלישי שמאטות תגובה.

CLS – כשכפתור "בורח" מהלחיצה

Cumulative Layout Shift מודד כמה אלמנטים "זזים" בעמוד בזמן הטעינה. היעד המומלץ הוא CLS מתחת ל-0.1 ב-75% מהביקורים. הפתרונות הנפוצים: הגדרת רוחב וגובה מפורשים לתמונות ווידאו, שמירת מקום מראש למודעות, טעינת פונטים עם font-display: swap, והימנעות מהזרקת תוכן דינמי מעל אלמנטים קיימים.

טיפ מקצועי: בדקו את ה-Core Web Vitals שלכם ב-PageSpeed Insights ושימו לב לנתוני השדה (Field Data) – הם משקפים את החוויה האמיתית של המשתמשים ולא רק סימולציית מעבדה.

האתר שלכם איטי מדי?

שיפור Core Web Vitals יכול להעלות את הדירוג ולהוריד נטישה בו-זמנית. נבדוק את הביצועים שלכם בחינם.

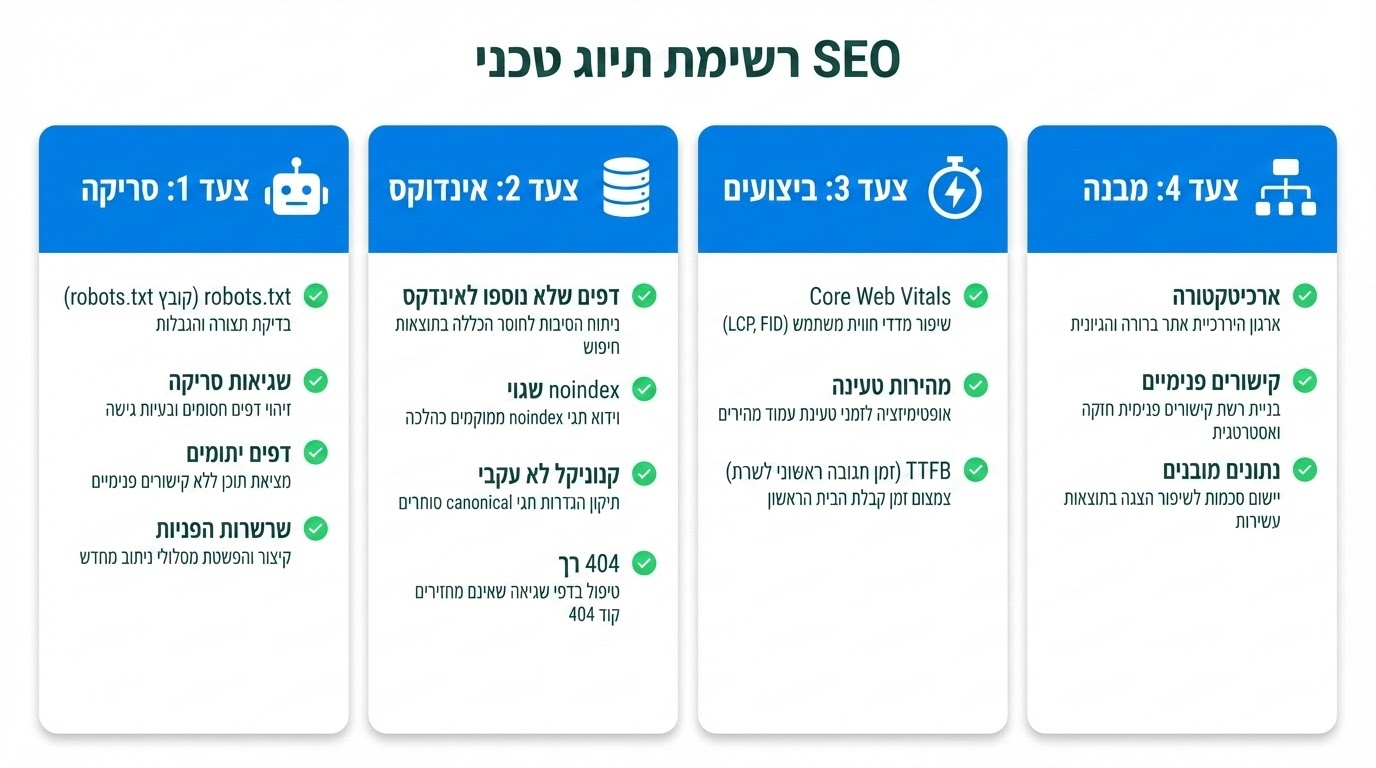

כיצד מבצעים Technical SEO Audit – צ'ק-ליסט מעשי

ביקורת טכנית (Technical Audit) היא התהליך שבו בודקים את כל השכבות הטכניות של האתר ומאתרים בעיות שמונעות ממנו להתקדם. הסדר חשוב, כי אין טעם לטפל בביצועים אם גוגל לא מצליחה בכלל לסרוק את האתר.

| שלב | מה בודקים | כלים מומלצים |

|---|---|---|

| שלב 1: זחילה | robots.txt, שגיאות סריקה, עמודים יתומים, שרשראות הפניה | Google Search Console, כלי סריקה חיצוניים |

| שלב 2: אינדוקס | עמודים שלא מאונדקסים, noindex שגוי, canonical לא עקבי, Soft 404 | Search Console – דוח דפים |

| שלב 3: ביצועים | Core Web Vitals, מהירות טעינה, TTFB | PageSpeed Insights, CrUX |

| שלב 4: מבנה | ארכיטקטורה, קישורים פנימיים, נתונים מובנים | כלי סריקה + בדיקת Schema |

ביקורת טכנית מעמיקה דורשת כלים מתקדמים וידע מקצועי. במסגרת תהליך קידום אורגני מקצועי, השלב הראשון שנהוג לבצע הוא אודיט טכני מלא – כי בלי תשתית תקינה, כל השקעה בתוכן או בקישורים מייצרת תשואה חלקית בלבד.

תרחיש מהשטח: אתר שהמכירות שלו צנחו אחרי מעבר פלטפורמה

מקרה שחוזר על עצמו: עסק מחליף פלטפורמה, משקיע בעיצוב חדש ובחוויית משתמש – אבל שוכח לטפל בהפניות 301 מהכתובות הישנות לחדשות. התוצאה: מאות עמודים שדורגו היטב מחזירים 404, כוח הקידום מתאדה, והתנועה האורגנית צונחת תוך שבועות. התיקון דורש מיפוי של כל הכתובות הישנות, בניית הפניות מדויקות, ותהליך בקשת סריקה מחדש.

הגישה שלנו בהראל דיגיטל: לפני כל שינוי מבני באתר, מתבצע מיפוי טכני מלא של כתובות קיימות, בניית תוכנית הפניות, ובדיקה לאחר ההשקה שמוודאת שאף עמוד חשוב לא "נפל בדרך".

נתונים מובנים, מובייל ואבטחה

נתונים מובנים (Schema Markup)

נתונים מובנים הם קוד (בדרך כלל בפורמט JSON-LD) שמוסיפים לעמוד כדי לומר לגוגל בדיוק מה יש בו: מוצר, מתכון, שירות, מאמר, שאלות ותשובות. גוגל משתמשת במידע הזה כדי להציג תוצאות עשירות (Rich Snippets) – כוכבי ביקורת, מחירים, שאלות נפוצות ועוד. היתרון הגדול: שיפור אחוז ההקלקה (CTR) גם ללא שיפור במיקום הדירוג.

התאמה למובייל

גוגל כבר מזמן עברה ל-Mobile-First Indexing – כלומר, היא סורקת ומדרגת את האתר לפי גרסת המובייל שלו בלבד. אם התוכן במובייל חלקי, אם הכפתורים קטנים מדי ללחיצה, או אם הטקסט לא קריא ללא זום – זה פוגע בדירוג. חשוב לוודא שגרסת המובייל מכילה את אותו תוכן ואותם קישורים פנימיים כמו גרסת הדסקטופ.

אבטחת HTTPS

פרוטוקול HTTPS הוא כבר מזמן לא "בונוס" אלא סטנדרט מינימלי. אתר ללא HTTPS מקבל תיוג "לא מאובטח" בדפדפנים, מה שמרתיע משתמשים ופוגע באמינות. מבחינת גוגל, HTTPS הוא גורם דירוג – לא מכריע לבדו, אבל חסרונו בולט.

JavaScript ו-SEO

אתרים מודרניים רבים בנויים על פריימוורקים כמו React, Angular או Vue, שמרנדרים תוכן בצד הלקוח. הבעיה: גוגל אמנם מסוגלת לרנדר JavaScript, אבל התהליך איטי יותר, צורך יותר משאבים, ולא תמיד מבוצע מיד. תוכן שנטען רק אחרי ריצת JavaScript עלול לא להיכנס לאינדקס כלל. פתרונות מקובלים: Server-Side Rendering (SSR), Pre-rendering, או Dynamic Rendering.

לא בטוחים אם גוגל רואה את התוכן שלכם?

בדיקת "Inspect URL" ב-Search Console תגלה את האמת

האם כדאי לעשות SEO טכני לבד או עם מומחה?

בדיקות בסיסיות כמו מעקב ב-Search Console, בדיקת מהירות ב-PageSpeed Insights ותיקון קישורים שבורים – אפשר ורצוי לעשות לבד. אבל ברגע שמדובר בבעיות מורכבות (שרשראות הפניה, Index Bloat, בעיות רינדור, ארכיטקטורה לא נכונה, שגיאות canonical רחבות) – טעות בטיפול עלולה להחמיר את המצב. SEO טכני דורש הבנה של איך שרתים עובדים, איך גוגל מפרשת קוד, ומה ההשלכות של כל שינוי.

בהראל דיגיטל, הקידום הטכני הוא חלק אינטגרלי מכל תהליך – לא פרויקט חד-פעמי אלא מעקב שוטף שמוודא שהתשתית תומכת בצמיחה. כשהטכנולוגיה עובדת בשבילכם ולא נגדכם, כל שקל שמושקע בתוכן ובקמפיינים מייצר תשואה גבוהה יותר.

כמה זמן לוקח לתיקון טכני להשפיע על תוצאות? אין תשובה אחת – תיקון חסימת robots.txt באתר קטן יכול לתת תוצאות תוך ימים. שיפור Core Web Vitals באתר גדול עשוי לקחת שבועות עד שנתוני השדה מתעדכנים. כלל אצבע: ככל שהתיקון קרוב יותר לשכבת הזחילה והאינדוקס – ההשפעה מהירה יותר.

מוכנים לגלות מה מעכב את האתר שלכם?

אודיט טכני מקצועי יחשוף את הבעיות ויתן לכם תוכנית פעולה ברורה. התחילו עם שיחת ייעוץ חינם.

מה הלקוחות שלנו אומרים

ביקורות אמיתיות מלקוחות מרוצים

שאלות נפוצות